ARM与x86–ATOM的前生今世

作者 陈怀临 | 2010-11-27 09:51 | 类型 弯曲推荐, 芯片技术, 行业动感 | 55条用户评论 »

系列目录 ARM与x86【陈怀临注: 我会在最近的一段时间,with some reasons,比较深入的去学习和了解Cortex-A9。这也是我在弯曲评论会开始多谈谈ARM的原因。我个人以前是对IXP或者说ARMV5比较熟悉。Cortex-A9是ARMV7。Sailing(http://blog.sina.com.cn/sailingxr)关于ARM的文章相当不错和专业。希望读者都能收益。弯曲评论发展到今天,就应该广泛的吸收天下人的智慧,这才是凝聚力量和发扬光大的唯一方式,靠和只靠编辑自己是不现实的,也是不应该的。。。另外,弯曲评论前端时间也有专门的关于ATOM的分析文章,可参阅:Intel ATOM处理器剖析与研究】

ATOM的前生今世

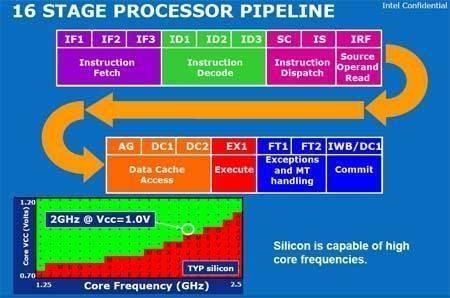

世间本没有PC处理器和嵌入式处理器。这两种处理器在同一天诞生。 1976年5月,Intel开始设计8086处理器。工程师没有想到这颗处理器将给后世带来如此深远的影响。如同许多改变人类命运的设计一样,设计者最初并没有太大的追求,诸多的不经意与偶然促成了一个伟大的产品[24]。1978年6月8日,Intel正式推出8086处理器[25]。1981年8月12日,基于8088处理器的IBM PC诞生[26]。很快PC席卷了整个世界。 嵌入式处理器这个称呼也随出现。从广义的角度上讲,所有处理器都是嵌入式处理器,包括用于服务器,PC和嵌入式领域的处理器。PC的日益普及,使得PC处理器从广义的嵌入式领域中脱颖而出,成为单独的一个产业,也就有了PC处理器。 在不久的将来手机也将从广义的嵌入式领域中独立,也会有单独的手机处理器,而不再是嵌入式处理器在手机中的应用。ARM处理器在手机领域的强势地位使得越来越多的人将其贴上了手机处理器的标签。更多的人认为将来的PC是揣在兜里的,而不是装在包里的。这些猜测触动了Intel这个巨人的心,失去未来的PC是Intel无法承受之重。 巨人的行动并非永远迟缓。2004年,地处Texas州的Intel Austin研发队伍启动了代号为Silverthorne的项目,这个项目所研发的芯片将取代A100和A110这两个低功耗处理器(A100和A110处理器的项目代号为Stealey,基于90nm工艺,是Pentium M的派生芯片[27])。这颗芯片也将是第一颗Atom处理器。Silverthorne项目的启动为两年后Intel毅然抛弃XScale构架埋下了伏笔。拥有顶尖处理器设计能力的Intel绝不允许ARM在旁酣睡。 Austin的研发队伍在项目启动时收到了来自高层的三条指令。Atom处理器必须是一个低功耗芯片,TDP(Thermal Design Power)约为ULV(Ultra Low Volatage) Dothan(即Intel Celeron M ULV)内核的十分之一(Dothan的TDP约为21瓦)。同时这颗处理器必须有足够的性能可以快速地浏览网页,流畅地运行高端操作系统[34]。这两条指令虽然苛刻,毕竟合理,也是可以通过努力实现的。 Austin的研发人员为此热血沸腾,也许他们将有机会创造一个完全不同的处理器,也许他们将有机会再一次改变这个世界。最容易想到的是使用RISC架构。从Pentium Pro开始,x86处理器使用了RISC流水线,在这条流水线中运行的是μops,并不是程序员使用的CISC指令。在流水线的开始阶段,x86处理器将CISC指令转换为μops,之后进入指令流水线运行。 如果能够将μops作为指令集直接提供给程序员使用,Austin的研发人员可以抛掉所有包袱,创造一颗完全不同的处理器。这个处理器可以自由地使用Intel从Pentium Pro开始的,并经过若干次改进而调优的μops流水线。Intel引以为傲的PCI/PCIe局部总线架构也可抛弃,毕竟PCIe设备的耗电量远大于ARM的AMBA设备。 主推一个新的指令集ISA(Instruction Architecture)是一件异常困难的事情。对于Intel这并非不可实现的。使用μops作为新的ISA,不过是将原先由硬件进行的指令翻译过程(Instruction Transforming)转交给编辑器。之前基于x86处理器的程序只需经过重新编译,就可以运行在新的处理器平台上。一旦放弃了CISC指令集,Austin的工程师可以自由地使用Intel所有的技术积累,更重要的是这颗处理器可以借鉴整个处理器界的成果。在多数情况下,新设计的处理器总比之前的好些。 所有这一切不过是研发人员的一厢情愿。来自高层的指令坚定而且明确,这颗低功耗处理器还必须严格实现x86向前兼容。这意味着具有30多年历史的x86指令集,必须要不打一丝折扣地在这颗芯片上实现。向前兼容是Intel巨大的利润来源,也是摆在这个星球上最顶级处理器设计人员面前的一个不可逾越的山峰。在Intel并不长的历史中,违背向前兼容的例子只有以惨败而告终的Itanium。 多少年来,Intel的领袖集团都很偏执,偏执的侧重各有不同。格罗夫偏执着改变,将Intel从一个存储器厂商塑造为处理器厂商,更多的偏执着使用了三十多年的x86指令集。 Intel处理器的开发史是工程师与向前兼容不断斗争的奋斗史。许多年之前,Intel凭借向前兼容这一利器,打败了所有RICS厂商,包括DEC,SUN,Motorola和IBM,一统PC与服务器领域。这并不意味着CISC处理器战胜了RISC处理器,事实上x86处理器进化成为RISC处理器,只是依然披着CISC指令的外衣。 对CISC指令的向前兼容需要许多额外的晶体管,更重要的是Intel从1978年使用至今的CISC指令绝非完美,PowerPC和ARM用区区两三百页就能描述清楚的指令集,x86处理器需要使用1千6百多页。x86处理器的指令不仅冗长,更糟糕的是并不等长。处理这些不等长引发的对界问题是众多IC程序员的技术噩梦。 Itanium处理器决定放弃向前兼容,却成了Intel的一场商业噩梦。Intel至今没有醒来,也不敢在Atom处理器上重新进行尝试。一次错误并不意味着下一次依然错误。也许Atom处理器已经错过了再次改变世界的良机。也许Intel错过了丢弃这个糟糕指令集的机会,失去了这个可能的伟大变革,也可能失去了整个世界。 变革不仅需要勇气,更多的是能力。放弃向前兼容的变革也许会使Intel再次获得历史赋予的机会,也许会毁掉Intel。这样的决定,是勇气,是梦想,是坚贞,是决别。这样的决定,诺伊斯可以做,摩尔可以做,格鲁夫可以做,贝瑞特不敢做,欧德宁不敢想。 Intel这样的大公司,只有创始人才敢做,也有能力做出一些伟大的变革,只有他们才有毁掉这个公司的勇气。领袖有了雄威之气,剩下的人才可能有雄威之气。贝瑞特和欧德宁们恐怕做梦都没有考虑过这些可能毁掉Intel的决定,虽然这个决定也可能是上天赐给Intel的机会。睡梦中的格罗夫也许曾无数次被怒火激醒,“再锋利的剑,到了你们手里只能是一把生锈的钝刀!”。 Intel使用了三十多年的CISC指令又一次被强加在Atom处理器中。失落的设计人员需要再一次为向前兼容付出惨重代价。Intel天才的工程师需要再一次直面这些为处理CISC指令而带来的古怪逻辑。Atom处理器再一次被套上枷锁。Intel再一次丧失了和ARM站在同一起跑线上的机会。 与RISC构架使用的定长指令集不同,Intel的CISC指令的长度从16b到120b不等[35]。变长的指令为指令译码部件带来了额外的负担,而且基于CISC指令的流水线很难进一步提高速度和并发指令条数。从Pentium Pro开始,Intel抛弃了CISC指令流水线,而使用μops流水线,为此在x86处理器中需要使用一个特别的指令译码部件,首先将CISC指令转换为内部指令流水线可以识别的μops[33] [36],然后再送入μops流水线中执行。 x86处理器的绝大多数CISC指令可以方便地翻译成一条或者多条μops指令,也可能是多条CISC指令被优化成为一条μops指令。仍有为数不多的过于复杂的CISC指令需要借助Microcode ROM进行查表译码,x86处理器处理这些指令的效率极低,但是这些指令出现的频率极低,并不会影响指令译码效率[33]。 Silverthorne处理器可以使用两种方法实现严格的向前兼容,或者使用μops流水线,或者使用CISC流水线。使用μops流水线也意味着Atom处理器必须保留将CISC指令转换为μops指令的逻辑,也必须保留在绝大多数时间可以安然入睡的Microcode ROM。对于已经集成了23亿个晶体管的Nehalem EX处理器,增加这些古怪的逻辑并不会极大地增加功耗。对于TDP的设计目标仅有2.1瓦的Atom处理器,这些逻辑是不可能被接受的,因为这些古怪逻辑本身使用的功耗已经超过了一些低端ARM处理器[i]。 来自Austin的设计人员必须另辟蹊径。他们试图在Atom处理器中使用Intel最新的工艺,直接执行复杂的CISC指令,这也重新揭开了上世纪九十年代开始的RISC与CISC构架之争。在那场战争中,Intel打败了所有RISC厂商,这并不意味着CISC处理器战胜了RISC处理器。在PC服务器领域,Intel的x86处理器最终被RISC处理器同化,而在剩余的几乎所有领域中CISC构架被RISC构架屠杀。 面对CISC构架的举步维艰,Pentium Pro做出了折中选择。Atom处理器却要继续扛起CISC的大旗。所有这一切并不是因为CISC构架仍有可能优于RISC构架,而是Austin的工程师面对向前兼容的不得已。 也许使用第一流工艺可以化腐朽为神奇,也许使用最顶尖的工程师可以将一个O(N2)算法实现得比普通工程师实现O(N×LogN)算法更为快速。也许这些“也许”永远都是“也许”。虽千万难,吾独往矣。帝国启动了赌局。 第一个需要改变的是Power设计理念。多年以来,Intel在PC和服务器上有关Power和Performance性能的设计理念是,处理器提升1%性能,Power可以提高2~3%。在Atom处理器中,这个比例是1比1,处理器每提升1%性能,相应的Power不能提高1%[37]。 Atom处理器被迫抛弃了许多在Core 2和Nehalem处理器使用中的高效设计,从零开始。与诸多传说并不一致,Atom并不是削减版的Pentium M或者Core 2。虽然Atom处理器是Intel自Pentium处理器以来最为简单的设计,也是一个全新的设计。这个全新的设计使用了Intel最为古老的CISC流水线。 无奈的工程师们面对由来已久的向前兼容,剩下的选择除了无奈,还是无奈。没有人愿意直面x86处理器这些乖张,谬妄,怪僻,荒诞的CISC指令,也没有人敢甚至去说说挑战“向前兼容”的不合理。 使用μops流水线无法越过Power的天堑,剩下的只有CISC流水线。无奈的设计人员第一个想到的是1989年发布的486处理器[ii],这颗处理器使用了单发射(single-issue),顺序执行(in-order)的CISC流水线。 即使在当年486也不是一个顶级处理器,Atom处理器必须对此加以补充。多发射技术仍是必须的,Atom处理器支持双发射。而现代处理器常用的乱序执行(Out-of-Order Execute)对于追求低功耗的Atom处理器是奢侈的,经过简单地评估,Austin的设计人员暂时放弃了乱序执行这个已经被广泛验证,可以显著提高流水线执行效率的功能。同时486处理器使用的5级流水线并不利于处理器主频的提升,Atom处理器将其提高到16级,如图1所示。 图1 Atom处理器的流水线[34] 这不是Atom处理器流水线的全部。Atom处理器还含有两级预先译码部件(Predecoder)。传统的x86指令并不等长,而是16b~120b,Predecoder部件的作用是划分指令边界,然后将其导入L1指令Cache。因此虽然Atom处理器L1指令Cache的大小为36KB,而实际可利用大小仅为32KB,剩余的4KB用来存放SOI(Start of Instruction),EOI(End of Instruction),等一些TAG信息[34]。 Atom处理器可以直接处理多数CISC指令,但是仍然有一些过于复杂的CISC指令被分解为若干个μops,再进入指令流水线。Atom处理器的流水线并非没有可取之处,这颗处理器可以直接执行ALU/Memory指令。这类指令首先被分解为ALU和Memory两个微操作,然后成对进入流水线,虽然Memory操作仍不能先于ALU操作执行完毕,也明显提高了这类指令的执行效率。Atom的指令流水线远不如RISC架构那样完美,但这是Intel的工程师在向前兼容的大前提下,为降低功耗而进行的一次大胆尝试。 Atom使用按序执行流水线,使得HT(Hyper-Threading)技术的引入成为必然。HT技术是Intel对SMT(Simultaneous Multithreading)技术的一种称呼。在现代处理器的设计中,可以使用两种技术在节约整个设计成本的前提下大幅提高并行度,一种是提高ILP(Instruction Level Parallelism),一种是增强TLP(Thread Level Parallelism)[38]。 Superscalar技术是提高ILP最常用的方法,Superscalar技术是指在同一个时钟周期CPU可以发射多条指令。这一技术最早出现在1964年,Seymour Cray的CDC6600就使用了这一技术[39]。这一方法在绝大多数高端处理器中得到了广泛的应用。Intel的高端处理器可以并发执行3~4条指令。 TLP技术最常用的实现手段即为SMT。来自DEC的工程师准备在Alpha21464(EV8[iii])上率先实现SMT技术。Alpha21464还没有完成最终的Tape-Out,就因为需要为Itanium让路而被迫取消[40][41]。这也是在学术领域无所不能的Alpha处理器的最后绝唱。DEC的这些工程师经过多次辗转,最终在Pentium IV上实现了HT技术。此后MIPS MT和Power5处理器也实现了SMT技术。 HT技术的本质是在同一个CPU中支持多个线程,每一个线程都具有独立的通用寄存器,Local APIC等其他资源,所有的线程共享同一条流水线,可以是一个线程的指令处于流水线的译码阶段,而另一条线程的指令处于执行阶段。当某个线程因为需要执行一些耗时较长的指令时,流水线可以切换到另外一个线程继续执行以避免流水线的阻塞[iv]。对于某些需要大量访问共享资源的应用,使用SMT技术不仅不能提高流水线效率,反而会降低。 Intel声称使用了HT技术的Atom处理器,可以提高36~47%的效率[34]。这也无法回避某些Benchmark的结果,使用HT的结果更加糟糕。有一点是可以肯定的,不支持乱序执行的Atom处理器如果还不支持HT,其执行效率是不值得去评估的。 体系结构上的缺陷很难用任何技术去弥补。Intel依然坚持尝试。在Atom处理器的L1 Cache中的一个Cell使用8个晶体管,与使用6个晶体管的设计相比,这种设计显然将占用相对较大的die size,但是却可以使用更低的工作电压,从而最终降低功耗[28]。但是这些优化不能弥补Atom为支持“向前兼容”而带来的,来自体系结构上的先天缺陷。 第一代Atom处理器,Silverthorne和Diamondville早已问世。基于Atom处理器的Asus EeePC和Acer Aspire One取得了不俗的战绩。第二代Atom处理器,Pineview也得到了帝国各个成员的拥戴。向前兼容策略持续着过去的成功。PC领域因此多了两个新的成员,Netbook和Nettop。这两个新成员被赋予了一个新的名字,上网本。 Asus的第一个上网本EeePC预装着Linux操作系统[31],这个产品并没有被Wintel帝国看好。而EeePC的成功出乎他们意料之外,2007年EeePC的销量达到300,000台[32],并迅速地向百万台销售目标进军。Microsoft如梦初醒,迅速作出反应,在EeePC上预装WinXP,很快在EeePC上Linux与WinXP的预装比例达到了1:9。这个比例依然没有完全反映Linux在上网本中所占的比例,毕竟许多预装着Linux的上网本是销往中国的。随后比WinXP更加秀丽的Win7也出现在上网本中。 Wintel再一次统治了上网本市场,也亲手毁掉了这个市场。最初灵巧便携的EeePC已经成为历史,越来越多的人们看到的是上网本中Atom处理器的低速与Windows的臃肿。上网本的唯一优点只剩下价格。至此上网本成为廉价笔记本的简称。当Apple的Jobs拿出第一个iPad时,属于Wintel的上网本盛宴已经结束。一个新的名词平板电脑(Tablet)被万众瞩目。ARM处理器和Apple却是主角。 Wintel帝国并没有彻底失败。Intel所需要的并不是上网本。Intel并不需要这样的产品去瓜分Laptop市场。帝国的终极目标依然是可以手持的PC。上网本不过是技术尚不成熟的临时产品。Intel很清楚的意识到初期的Atom并不能离开Windows,向前兼容依然重要。只是向前兼容这个紧箍咒套上容易脱离难。 Intel的Moorestown平台终于浮出水面。这是Intel为手持PC开发的第一款产品,与ARM的单芯片解决方案并不相同。Moorestown平台由两个芯片组成,分别是代号为Lincroft的处理器和代号为Langwell的芯片组。Lincroft中包含一个Atom处理器、GPU和存储器控制器,用Intel的45nm工艺实现,而在Langwell芯片组中包含手持PC中常用的外部设备,如摄像机接口、USB接口、1080p HDMI接口和NAND控制器等[29]。 Intel为了更快的推出Langwell芯片组,并没有使用自己的生产工艺,而是依靠TSMC的65nm工艺。这引发了人们无限的猜想,在诸多半导体厂商中,Intel始终坚持“in-house-design”的思路,一个芯片从设计到生产都在Intel内部完成,而且Intel有太多的工厂可以生产65nm的芯片。Intel究竟需要从TSMC获得什么? Intel的Roadmap揭示Moorestown平台仅是一个权宜之计,在并不久远的将来,Medfield平台会将Lincroft和Langwell合二为一,这也将是Intel有史以来第一个单芯片处理器[29][30]。这颗芯片依然采用Intel的“in-house-design”的设计理念吗? 这一切并不重要,从体系结构的角度上看,Moorestown和Medfield平台使用的依然是Atom处理器内核,并以某种方式连接着手持PC使用的外部设备。从性能/功耗比的角度上,基于ARM AMBA总线的外部设备目前是最优的,远胜过追求性能的PCIe设备。 Moorestown和Medfield平台与ARM处理器平台最终需要一决胜负的依然是处理器内核。与在SPECint_base_rate2006 benchmark程序获得117高分的Nehalem处理器(在此之前没有任何处理器获得100以上的分数)不同[42],性能并不是Atom处理器的优势。并不出乎体系结构专家的意外,在许多Benchmark程序下,Atom处理器落后于Cortex A9处理器[43],如下表所示。而Atom处理器使用的功耗与ARM处理器目前并没有可比之处。

Youtube上有一个流传已久的视频[44],一个1.6GHz的Atom处理器(很可能是N270)与一个双核500MHz的Cortex A9平台在相同的分辨率,相同的主存储器大小,相同的操作系统环境下,浏览网页的速度几乎不分上下。采用RISC架构的Cortex A9依然有非常大的潜力可以进一步提升性能,而在体系结构上强调向前兼容的Atom处理器早已被捆住手脚。 失去性能优势的ARM处理器,还有功耗。而失去了性能优势的Atom处理器,只剩下向前兼容。越来越多的人们开始发问,在手持式领域,向前兼容是不是如Intel所料那样重要?虽然Intel一再宣称x86处理器拥有最大的软件Ecosystem,但是目前已有的x86兼容的程序究竟有多少可以不加修改地移植到手持式设备中,又有多少硬件IP可以与PCIe总线直接互连? 如果在手持式设备中,“向前兼容”也不再重要,Atom处理器剩下的只有Intel耗费重金打造的芯片生产工艺。多年以来IT技术被归于高科技领域,这并不是指架个微机编写软件。半导体芯片的制作使用了人类有史以来最复杂的工艺。 首先是硅的提炼,硅原料被投入一个巨大的硅熔炉中,然后再植入一个精度极高的硅种,被融化的硅原料将围绕这个硅种生长,最后形成一个纯度至少为99.9999%的单晶硅锭(圆柱体)。这个硅锭的直径一般为8英寸或者12英寸。之后这个硅锭被切割为一个个Wafer(硅晶片),Wafer再被切割为一个个正方形的Die。每一个Atom处理器将使用一个Die。 这些Die将被多次影印(Photolithography),蚀刻(Etching),最后形成一个多层3D结构。至此Foundry完全结束。经过Foundry处理后的Die,将经过封装,测试等流程,最终成为一个个半导体芯片。 所谓纳米工艺是发生在Etching阶段,Etching也是半导体工艺技术的重中之重。经过影印后,硅晶片将被涂上一层光敏抗蚀膜,之后使用极短的紫外线曝光光敏抗蚀膜。最后用化学溶剂清除已曝光的光敏抗蚀膜连同其下的一层硅。曝光的硅最后将被原子轰击,以生成N井或者P井,最终实现门级电路。 45nm,32nm技术是指MOS晶体管栅极的宽度。这个宽度越低,在相同大小的Die中就可以集成更多的晶体管。贝瑞特时代的Intel抓住了半导体工艺的发展启动机遇,在诸多半导体厂商中脱颖而出。但是这种领先很难持久。半导体成产工艺是材料科学,化学工业,光学技术和精工机械的集大成者,本质上是一门实验科学,需要大量的资金投入。 Intel取得了先机,也毕竟是在以一隅敌全国。Intel率先在Westmere处理器上实现了32nm工艺,22nm也将在2011年中期实现[45][46]。这些成功并没有使Intel在工艺上扩大领先优势,这一优势反而在逐步缩小。ARM Cortex A9已经可以使用Global Foundry提供的28nm工艺。当22nm技术来临时,Intel在生产工艺上的领先优势将不复存在。 Intel率先推出45nm时,是与其他半导体厂商差距最大的时刻,在工艺上几乎领先其他半导体厂商一代。而技术的革新与进步总是开头最难,中期发展阶段最快,至末期的举步维艰。种种迹象表明硅晶片的制造工艺已日趋极限。 如果Atom处理器连工艺的领先都无从谈起,在技术上将没有任何优势可言。一个产品成败并不完全取决于技术。也许二十年前Intel战胜所有RISC厂商的故事可能再次发生,也许偏执的力量可以战胜顶尖的技术。 只是Intel已无格鲁夫。 | ||||||||||||||||||||||||||||||

雁过留声

“ARM与x86–ATOM的前生今世”有55个回复

sailing对Intel是相当的了解。我刚才让几个在Intel混了10+年的人看了看。都说sailing挺了解内幕的。。。。。。

文章中提到的Cortex-A9 PK ATOM的youtube视频为:http://www.youtube.com/watch?v=W4W6lVQl3QA

Intel ATOM处理器剖析与研究

铁臂阿童木—Intel ATOM处理器剖析与研究

http://www.tektalk.org/?p=5414

1. 铁臂阿童木——Intel ATOM处理器剖析与研究

2. 铁臂阿童木——Intel ATOM处理器剖析与研究(2)

3. 铁臂阿童木——Intel ATOM处理器剖析与研究 (3)

4. 铁臂阿童木——Intel ATOM处理器剖析与研究 (4)

5. 铁臂阿童木——Intel ATOM处理器剖析与研究 (5)

“变革不仅需要勇气,更多的是能力。放弃向前兼容的变革也许会使Intel再次获得历史赋予的机会,也许会毁掉Intel。这样的决定,是勇气,是梦想,是坚贞,是决别。这样的决定,诺伊斯可以做,摩尔可以做,格鲁夫可以做,贝瑞特不敢做,欧德宁不敢想”

太经典了!!!!

成也萧何,败也萧何?

ARM Cortex A9已经可以使用Global Foundry提供的28nm工艺。当22nm技术来临时,Intel在生产工艺上的领先优势将不复存在。———–Global Foundry所谓32要和INTEL22一起量产了·不懂工艺就不要乱说

Intel率先推出45nm时,是与其他半导体厂商差距最大的时刻,在工艺上几乎领先其他半导体厂商一代。而技术的革新与进步总是开头最难,中期发展阶段最快,至末期的举步维艰。种种迹象表明硅晶片的制造工艺已日趋极限。——-INTEL 32量产一年了,GF的32呢?2011 下半年,45落后INTEL12个月,32落后18个月,22会是24个月吗?

ARM Cortex A9已经可以使用Global Foundry提供的28nm工艺。当22nm技术来临时,Intel在生产工艺上的领先优势将不复存在。———–28本质是32的0.9X微缩版,性能和32差不多,作者对工艺几乎一窍不通啊

在今年上半年的时候,AMD公司曾经表示将会在2010年未推出代号为Llano的处理器,Llano同时集成有高性能的X86处理器核心以及DirectX 11显示核心。不过之后AMD表示由于32nm SOI工艺不够成熟,而无法实现商业化生产。因此由于产量的原因,AMD不得不延迟推出Llano。

而技术的革新与进步总是开头最难,中期发展阶段最快,至末期的举步维艰。种种迹象表明硅晶片的制造工艺已日趋极限。——-LOGIC以后还有FIN,有3-5,有多珊,作者对工艺几乎什么都不知道啊

GF实在是不争气啊,Intel的32nm成品早就铺天盖地了

可不是啊,32nm好象在我脑海已经是很久前的事情了,想不到到现在才起飞,intel都快降落,反正吹牛是不要钱 年底还有intel给的救济金

什么时候,GF再告TSMC垄断,搞一笔钱

ARM要学fusion,早晚ARM会打包Cortex A和MAIL的。以后客户可以直接得到FUSION CORE

Intel的工艺优势是一只存在的,并不是随便说说“……当22nm技术来临时,Intel在生产工艺上的领先优势将不复存在……”这样的话就能糊弄过去……

Heeee。希望王哥能路过。。。:-)。你看我,基本上不谈什么Serdes呀,什么SI呀的东东。。。这东西,一说错,就被逮住了。。。

From 65nm, can shrink to 60nm, 55nm.+

From 45nm, can shrink to 40nm From 32nm, can shrink to 28nm.

From 22nm, can shrink to 20nm.

@不懂工艺就不要乱说

非常感谢您的批评。也非常感谢弯曲评论能够提供这个平台。我会仔细评估您的意见,我暂时将我那篇有关Atom的文章设置为隐私博文。

等我充分了解这些工艺背后的故事之后,再重新公开。

您有什么相关这些工艺的参考文献吗?

不过至今为止除了Intel之外,确实没有其他的基于32nm的大规模商用芯片。

和一个IBM做工艺的刚刚核实过,他们22nm的芯片也已经出了,不过距离大规模商用仍然有相当长距离。估计Ivy Bridge还会提前发布。

我想表达的意思是,Intel以一己之力在工艺上对抗整个半导体联盟。而且工艺又是半导体联盟中必须要解决的问题。Intel的成功不能仅仅依靠工艺。如果Intel长期在工艺上大幅领先其他竞争对手,非半导体领域之幸。

@陈首席。

我们曾在北京有一面之缘,而后的消息是您去了大宋。大宋挺好的,我在那里也有一些朋友。

感谢陈首席,指出了Corelink的问题,这确实是个大问题,我会在周末重新规划这些改动。这篇文章是在为我了却一个心愿。

我一直想把PowerPC,x86,MIPS和ARM处理器微架构分别出一本书。我习惯用内核了,不习惯用微架构。

目前完成只完成了PowerPC部分,而且我对这本书非常不满意,等过了出版社的期限,我会把这本书开源,不过会删掉Linux的部分。实际上Linux系统我熟悉的也不过是和体系结构密切相关的部分。

x86处理器中Intel的IP太多了,Intel不公开就没有办法写。我曾试图写过,我之前写的《PC的足迹》本应是“x86处理器体系结构导读”的前言。只是深入了解x86架构后,却发现没有办法书写这本书,这不是一个人能够写出来的。在Intel的两年,每一天都在看Nehalem的微架构手册,实在是太多了,仅懂一些皮毛。

MIPS和ARM,一直没有机会做真正有价值的设计。当然这类板卡设计做了不少,也调通了几个BSP,实在是不足为道。

近期我会跟出版社商量一下,看能不能公开PowerPC这本书。如果可以公开,请首席给个位置,就在这里公开了,更希望您能一起改改,这样更加完整一些,原稿错误多了些。PowerPC处理器实在是又爱又恨,IBM的芯片是自己卖给自己,Freescale被黑石收购后,芯片推出的速度实在太慢。

将来应该不会在出版纸质书籍了,我觉得早点公开了更好,有问题可以被及时发现,就像“不懂工艺就不要乱说”这样可以及时指出。对于一个文章,最大的困楚莫过于读者先争议都没有的“哀莫大于心死”。

这些书和这些文章是我的呕血谱,最忙的时候一天只休息三五个小时。我写这些书,包括这些文章最重要的目的就是让后来者,不要继续走我经历过的弯路。如果有误导,是我最不能忍受的。

80年代的人距离我们太近,看到的更多的是缺点。90年代和21世纪的年轻人,让我看到了希望。所做的一切仅是为了这些希望。

我们这代人做经历的,所做出的,注定微不足道。也许在这些微不足道的积累中,会撒下希望的种子。

弹指一挥间,一代注定更比一代强。

倘若如此,我们的付出是值得的。倘若如此,民族幸甚。

顶楼上,了不起的胸怀。

我觉得是王总有些杞人忧天了……Intel的成功显然并不是仅仅依靠工艺,很明显

就工艺而言,IBM/Samsung等Gate-first派和Intel/TSMC等的Gate-last派还是较有区别的,同样的制程难度也不尽相同

IBM是很有技术的,但是其产品没有x86这样的规模

RE:Qi 和一个IBM做工艺的刚刚核实过,他们22nm的芯片也已经出了,不过距离大规模商用仍然有相当长距离。估计Ivy Bridge还会提前发布。———-我前几天和GF的沟通过,基本上IBM的32NM SOI 要和INTEL 22一起量产了,Gate-first到现在仍然有很多问题,IBM有可能重蹈LOW-K的覆辙,FAIL掉,

。

RE:Qi 我想表达的意思是,Intel以一己之力在工艺上对抗整个半导体联盟。而且工艺又是半导体联盟中必须要解决的问题。Intel的成功不能仅仅依靠工艺。如果Intel长期在工艺上大幅领先其他竞争对手,非半导体领域之幸。——尽管他们或许能筹集足够的投资,但要达成共识并着手开发工作,或许要花更长的时间。因而公司联盟是否能成为一种行之有效的模式,目前还难以断言。

We believe Intel will introduce a germanium (III V) channel and full depleted SOI at 22-nm. This will give Intel a quantum leap in performance over what they are achieving and leave competitors 3-5 years behind

现在IBM联盟的研发-量产模式 研发靠IBM,量产靠GF和SAMSUNG,很多学生仍然认为IBM技术强大,但业内人士结论完全相反,IBM LOW-K输了一次。HIGH-K再输,IBM半导体就玩完了

现在工艺三大集团 INTEL IBM TSMC,INTEL 不是工艺一直强,P4早完了。gate last TSMC是看了INTEL量产几年后,FIRST有玩不下去,可能从TI哪里弄来技术,转行为LAST

FSL的E5500只是E500的64BIT扩展版,而他们声称E700仍然存在,Qi在FRESCALE那么长时间,知不知道E700的最新进展呢?

整体上评价工艺水平 两种观点 学术界Intel>IBM>TSMC 产业界Intel>TSMC>IBM

诸多半导体厂商中,Intel始终坚持“in-house-design”的思路,一个芯片从设计到生产都在Intel内部完成,而且Intel有太多的工厂可以生产65nm的芯片。Intel究竟需要从TSMC获得什么?———–Chandrasekher:「基于Langwell应对市场要求的功能。我们确定了与手机厂商以及家电厂商的协议结果,他们要求的IP块与Intel现有的东西多少有些差异。因此决定第二芯片由TSMC代工。说到原因是由于TSMC拥有很多的(我们顾客需要的)IP

这表示Intel还无法满足顾客的需求,因此就将芯片组交由TSMC生产。而且Lincroft合并了功能的Moorestown与以前的Menlow相比在功耗上也成功下降了许多。

诸多半导体厂商中,Intel始终坚持“in-house-design”的思路,一个芯片从设计到生产都在Intel内部完成—INTEL的南桥一直有外包,Langwell其实相当于南桥,加上有很多客制化IP,由TSMC生产是自然之选

RE:Qi,我对工艺很了解,不知道是否方便和你交流

數年前以IBM為首的眾多處理器廠商,競相投入銅導線製程,英特爾卻依然堅守鋁導線,所以創造了「沒有銅的銅礦」(Pentium 3 180nm製程核心的代號為Coppermine)。當時英特爾認為,銅導線製程尚未成熟,鋁導線依然有相當大的應用潛力。後來,英特爾是直到130nm製程的Northwood才導入銅導線,遠落後於其它廠商。但是,英特爾並沒有因此吃虧,依然維持對競爭對手處理器產品效能及時脈上的優勢。目前英特爾對SOI晶圓的保守態度,就是一個很好的佐證。

对性能效率的追求离不开芯片生产工艺的进步。看得出“不懂工艺就不要乱说”对工艺非常懂,希望大牛能开篇文章,系统的帮大家梳理一下,扫个盲。

还有,懂Serdes的的同学们,你们出头的时候到了,也贡献一篇吧。。。

我也对serdes也很感兴趣,特别是对高速10G Serdes过背板的应用,呵呵,不知道那家做得好呢

@请教Qi。E700的下落确实不知道,我在的时候号称要做,后来就是使用E5500而不是E700了。E700应该是没有了。

@不懂工艺就不要乱说。Lincroft和Langwell完整的数据手册我有,不过我不能写网上没有公布的东西。不知道您在哪里,我是在北京。邮箱是sailling.w at gmail.com。我们可以先Email联系,也好留下联系方式。国内多数人对后端的理解都不是很好,如果您能写篇普及型文章,会对国人有很大的帮助。

太好了,给我也扫扫盲吧,呵呵。期待中!

Qi的PPC大作在我们那里几乎人手一本

膜拜大侠。

sailling.w at gmail.com———–无法识别“收件人”字段中的地址“sailling.w at gmail.com”。请确保所有地址都使用正确的格式。

Freescale近年来在Power上进展缓慢,可是多核DSP MSC815x却神勇无比啊,逼得TI推出C66x,Freescale自家的8157/8也登场了。

Heee.大牛们齐聚一堂。人间快事!王齐,咱们在北京还见过面?:-)。是我参加你的粉丝会,还是。。。:-)。好,就这么定了,下次我去北京,一定咱哥俩喝一杯。你知道,我也写过Linux/PPC,但都是在网上。很早,乱写的。

唉,天下英雄。我真想都认识。。。

阿杜,我算反应过来你是谁了。。。你还是把多核ARM的事情好好帮我整一整。。。你看那个乱的。。。

弯曲的平台又吸引来一个大牛,看把首席高兴的,呵呵

最近用Freescale的i.MX处理器做一个项目,性能要求不高,就是LCD分辨率大一点,横向有1280,本来打算用ARM926核的imx25,结果其最大分辨率只能到1023,最后只能imx51这个A8架构的来大材小用。总感觉Freescale的市场策略有问题,想在消费电子占领市场,却又采纳工业控制上的一些设计,其imx51最近被国内不少厂商拿来做平板的方案,但硬件解码却只能到720P。。。总感觉它像之前的Moto手机一样,什么平台都有,但最后。。。。

这个“不懂工艺就别乱说”的弟兄,如果我是你,会是这样的ID,“我懂工艺我敢说”。See,同样的事情,表达就不一样了。。。

每个人都有knowledge hole。。。我算够杂的了。但还是欠缺的太多。。。

to 39楼:

呵呵,哥们,你的要求太高了。

IMX25是ARM926的核。在ARM9时代,你看到有哪种产品的分辨率超过800×480的。ARM9的产品,因为成本问题,一般都没有2D加速模块,都由CPU运算。1280×720 16-bit 25fps,算算要多少memory带宽了。CPU能算得过来,memory总线速率都不够了。

IMX51可以硬解码720P,也可以播放720P。其实测试下来,也可以部分硬解码1080P。IMX51/53的BSP基本通用,53可以解码1080P,也就是频率上去了。至于能播放1080P的产品,再等等吧。

楼上,如果横向比较的话就有问题了,三星S3C2410,核比imx25还弱,但分辨率硬是可以支持到2040×2048.其实很多产品虽然用那么大的分辨率和屏,但并不要求在全屏下播高清。只是一个控制界面上的应用,比如那些售票系统。

再者说到高清播放,也是棒子的芯片tcc8902,只是arm11架构,但SoC里面就集成了硬解1080P的IP。。。

所以我觉得Freescale真想做消费电子就得好好看看别人的产品。不过话说回来,很多欧美那边的客户就是认Freescale的牌子,不认三星的东西,这是曾经M68K埋下的口碑啊

楼上:

前面我说的是ARM9的电子产品没有超过800×480分辨率的。这是受限于CPU的性能和memory总线性能。如果你用S3C2410去驱动800×480的屏,可能就会看到要分两次才能刷一个全屏。如果去驱动2040×2040的屏,那将会看到一次刷新是一条扫描线一条扫描线从上到下慢慢流下来。这是可能性和可用性的差别。其实分辨率和屏幕物理尺寸不是紧密绑定的。象控制界面的应用,并不要求画面的细腻,完全可以选择ARM9/11系列的产品,分辨率控制在800×480以下,物理尺寸在7″以上,这还是有方案选的。当然,要忽悠洋鬼子,是越贵越新的越好。

至于高清播放,我前面是特意区分解码和播放两个功能。Telechips 8902,是可以硬解码1080P。但市面上的产品都是7″ 800×480的屏幕。你让厂商把分辨率提到1024×600试试看。:-(

http://vanshardware.com/2010/08/20/

这里还有个全面的横向测试分析文章,在Ubunu 9.04下Cortex-A8 800MHz vs Atom N450 1GHz,还有威盛Nano,AMD Athlon.很显然是A8还不是对手.

很期待明年的双核A9产品和Moorestown在同一操作系统下的对决测试.

43楼上第一段我认可,从CPU和总线性能来看,确实800×480是个阈值。再大了刷新频率就下降了。不过我们这个应用的分辨率比较特殊1280×120,所以相比之下s3c2410的优势就比imx25大了。imx25的寄存器限制最大为1024了

第二段就不认可了,呵呵,我最近刚拿了一个tcc8902的android平板,分辨率确实是1024×600,9.7寸的屏,播1080P高清很流畅。我没有看过tcc8902的spec,ARM11支持AMBA 3.0 AXI总线,从mali解码后DMA到framebuffer应该没问题吧

A8跑ubuntu确实不行,运行firefox很卡,不知道是不是软件的优化不够好。

但是跑android还是可以的,应该在android下面比一下benchmark,呵呵

呵呵,Telechips终于把分辨率提上来了。当初给我们的答复是:有困难,有希望,我们一直在努力。:-)

不过我估计1024×600也是89xx系列的极限了。作为一个低成本方案,能做到这点,他们是够努力的了。

UBUNTU跑起来慢,那是肯定的了。一是UBUNTU自己不敢优化,二是厂商也懒得给他们优化。工程师都在ANDROID组里面了。

ANDROID跑得快,那是厂商屁颠屁颠地给GOOGLE打工,做优化。所有可能的优化参数都用上,再用GPU做显示的底层。所以ANDROID版本一定比UBUNTU的要明显快。

棒子做这些低成本方案目前还是比较厉害,这个89xx系列把瑞芯微整得够呛。

给google打工虽然比不上给apple打工,但比给Microsoft打工总归要好一些,现在android在平板上的覆盖度越来越大。据说明年平板电脑出货量会到1亿,而ipad会占据75%,剩下估计20%给android+A8/A9,再剩个5%给atom。

Itanium,我还是初中生的时候Intel就天天吵着要出,结果我上大学了还没出,我怀着被抛弃的心情转而玩8051算了。

itanium—>8051….oh poor kid…

读完了qi的那几篇arm vs. x86的文章。作为一个在intel只待了两年就能了解如此透彻,真的很了不起。能天天抱着NHM的MAS看,intel中国都没几个人能做到。我接触过intel内机密度非常高的一个项目从而有机会接触内核。对当前CPU的内核我只能用浩如烟海来形容。那真正是无数人的设计结晶。

在intel,没有项目是失败的,即使它最终被砍掉,即使它并没有给intel带来任何利润。但是在设计过程中会有无数的创新并给后续项目采用。这也是intel能在危机之中快速反应一个很重要的原因。就凭这份经验和积累,无人能敌。

ARM vs. x86,现在无数人在关注着。起因有两个,ARM不满足于移动设备市场,想进军低端低功耗服务器市场。同时intel发现移动设备市场越来越大并在挑战者PC市场。

抛开软件。

在服务器领域高端性能仍是必须,这种高性能可以通过一台服务器实现,也可以通过几台联合提供。人们需要的是性能功耗比的一个曲线,而不是CPU压满情况下哪个点。高端服务器的问题在于那根曲线过于接近横线,而低端服务器的问题在于那根曲线过于接近竖线。两根线有一个交点,左边低端服务器赢,右端高端赢。intel需要保证的是ATOM server 那个点比ARM靠右一点。

在移动设备领域低功耗是王道,但性能也必不可少。市场不同两者要求也不同。目前状况似乎是A9占有优势,ATOM会快速赶上。功耗上ATOM可能会输,性能上intel不会有大问题。

有一点可以肯定,这一仗不会像06年对AMD那一仗那么轻松。

如果TILERA公司通过他们的imesh技术集成100个 ARM Cotex-15,是不是会对Intel在服务器领域造成比较大的影响呢,这样性能,I/O能力都应该是有保障的,不过不知道TILERA是不是愿意

学习了,谢谢!

许可证销售是个双刃剑,由于不生产,所以对生产工艺没有控制权,从架构发布到成品的时间周期过长,看看A15已经出来多长时间了,intel基本上架构出来了离产品上市也不远了。

看完再也不想玩x86